Sora獨占鰲頭,光芒掩蓋了其他科技巨頭,很少有人注意到Meta同期推出了視頻模型技術(shù)架構(gòu)V-JEPA。

驚嘆過后,Sora到底能不能代表“世界模型”,也成為新的爭議點。

Meta首席人工智能科學(xué)家Yann LeCun堅決指出,Sora并不能真的理解物理世界,“這樣的視頻生成與世界模型的因果預(yù)測仍然存在巨大差異”,并在接下來的幾天里就此話題與網(wǎng)友展開了唇槍舌劍的爭執(zhí)。

源源不斷的觀點輸出中,Yann LeCun更是直言,“通過生成像素來模擬真實世界,不僅是一種浪費,更是注定失敗”。

作為“世界模型”的理論先驅(qū),雖然Yann LeCun并未否認Sora在視頻生成方面的杰出表現(xiàn),但他始終強調(diào)Sora的生成式模型與“世界模型”相去甚遠,反而是JEPA架構(gòu)更能接近“世界模型”路線。

國內(nèi)也有技術(shù)分析人士指出:“Sora只是二維視覺的壓縮擴散和時空表達,既不是物理引擎,也不是世界模型。”

“世界模型”是目前技術(shù)流派中難度最高的一種,其特點在于讓機器能夠像人類一樣對真實世界有一個全面而準確的認知,不僅包括對事物的描述和分類,還包括對事物的關(guān)系、規(guī)律、原因和結(jié)果的理解和預(yù)測,從而進行推理和決策。

“世界模型”也被認為是通往AGI的最優(yōu)解。如果就這么被OpenAI搶去了“世界模型”的帽子,Yann LeCun是堅決不同意的,這位圖靈獎得主甚至在社交平臺憤怒表示:“我從沒想過,會看到這么多從未為人工智能或機器學(xué)習(xí)做過任何事情的人告訴我,我對人工智能和機器學(xué)習(xí)的觀點是錯誤、愚蠢、盲目、無知、誤導(dǎo)、嫉妒、偏見、脫節(jié)的。”

Yann LeCun炮轟Sora背后,Meta與OpenAI關(guān)于“世界模型”的路徑之爭,同樣激烈。

V-JEPA才是“世界模型”?

在Sora的技術(shù)文檔中,OpenAI并不是那么“open”,文中大量篇幅是在介紹Sora的厲害之處,除了文生視頻,還可以圖生視頻、拓展視頻等,并未披露技術(shù)原理,而是使用了一種結(jié)論式表達——通過擴大視頻生成模型的規(guī)模,我們有望構(gòu)建出能夠模擬物理世界的通用模擬器,這無疑是一條極具前景的發(fā)展道路。

隨后,英偉達AI研究員Jim Fan的觀點引領(lǐng)了輿論走向,他認為,Sora是一款數(shù)據(jù)驅(qū)動的物理引擎,是個可學(xué)習(xí)的模擬器或“世界模型”。

Meta的Yann LeCun明確反對,他指出,Sora只是經(jīng)過訓(xùn)練可以生成像素,但如果這樣的方式用來了解世界是如何運作的,那注定是個失敗的命題。

“視頻生成與‘世界模型’的因果預(yù)測有很大不同。” Yann LeCun表示,視頻生成似是而非的空間非常大,只需要產(chǎn)生一個合理的樣本就能視為成功,而真實視頻的合理延續(xù)空間要小得多,尤其是在特定動作條件下,難度就更大了。

Yann LeCun認為,實現(xiàn)“世界模型”更理想的方式,應(yīng)該是讓機器智能像人類般學(xué)習(xí)、建立起周遭世界的內(nèi)部模型,從而高效學(xué)習(xí)、適應(yīng)并制定計劃以完成種種復(fù)雜的任務(wù)。

這也正是他提出的JEPA(Joint Embedding Predictive Architectures,聯(lián)合嵌入預(yù)測架構(gòu))的核心思想:不是填充缺失像素的生成式,而是預(yù)測。

人類最初對世界的理解,是從最自然的“觀察”開始,在此基礎(chǔ)上進行學(xué)習(xí),總結(jié)經(jīng)驗,形成認知模型,即應(yīng)對每一種情況應(yīng)該采取什么態(tài)度或措施的“數(shù)據(jù)庫”。LeCun表示,JEPA就是基于這種邏輯。

JEPA在2022年由Yann LeCun首次提出。兩類模型I-JEPA和V-JEPA分別基于圖像、視頻進行抽象性預(yù)測。

Meta在官網(wǎng)上給出了參考視頻。筆記本被遮擋了一部分,而V-JEPA能夠?qū)P記本上的內(nèi)容做出不同預(yù)測并形成視頻圖像。Meta表示,這是V-JEPA在觀看200萬個視頻后才獲取的能力。

V-JEPA生成被遮擋的部分,即以“人類理解的方式”看世界,不是通過手動標注,而是通過像人類一樣的被動觀察來建立對視頻片段的概念理解。

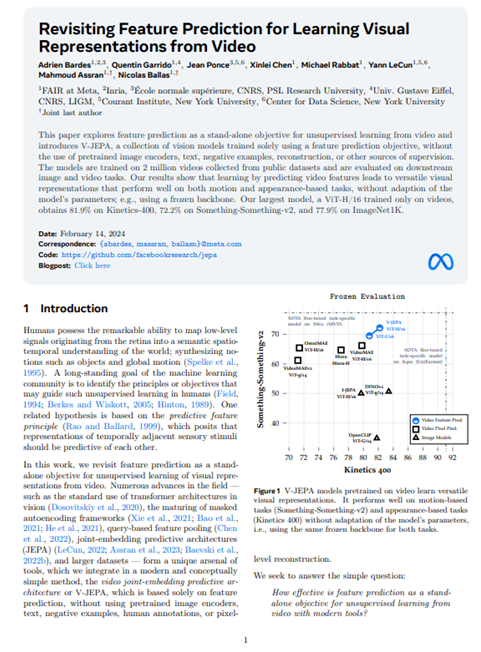

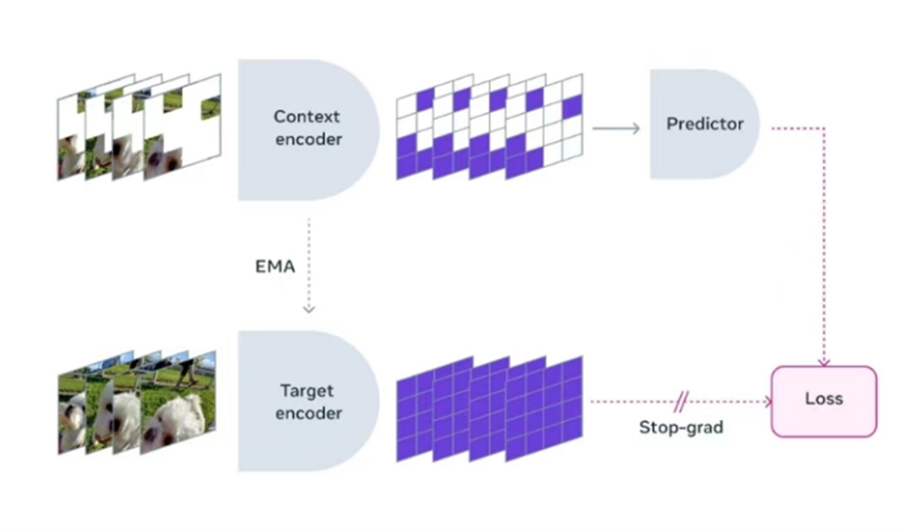

Meta2月14日發(fā)布的論文中較為詳細地介紹了V-JEPA的主要特點和工作原理。V-JEPA采取了一種特殊的網(wǎng)絡(luò)架構(gòu),其中包括一個編碼器(x-encoder)和一個預(yù)測器(predictor)。編碼器負責提取視頻幀的特征表示,而預(yù)測器則基于這些特征來預(yù)測目標幀的特征。

與以變分自編碼器(Variational AE)、掩碼自編碼器(Masked AE)、去噪自編碼器(Denoising AE)等為代表的重建像素的生成型架構(gòu)相比,JEPA聯(lián)合嵌入架構(gòu)能夠產(chǎn)生更優(yōu)秀的視覺表達。

(論文部分截圖)

(V-JEPA訓(xùn)練機理圖示)

Meta提出,V-JEPA的出現(xiàn)是朝著AMI(Advanced Machine Intelligence)邁出的重要一步。而隨著V-JEPA技術(shù)的發(fā)展,關(guān)于AI是否真正能夠?qū)W會以人類的方式思考、是否能夠擁有人類思維等人文倫理問題,或許會成為未來討論的焦點。

財報中的AI成色

Meta最近披露的財報,收獲了史上最佳成績,2023年第四季度實現(xiàn)收入401.11億美元,同比增長25%,這也是其自2021年三季度以來的最大季度增幅。

漂亮的財報之后,資本市場也給予了Meta積極反饋。2月2日,Meta市值暴漲,股價一天內(nèi)漲逾20%,創(chuàng)下美股歷史最高單日漲幅紀錄,市值隨之上漲2045億美元。截至2月21日,Mata股價為471.75美元/股,市值達到1.2萬億美元,正是山巔榮耀時刻。

Meta首席執(zhí)行官馬克·扎克伯格(Mark Zuckerberg)指出,Meta在推動人工智能和元宇宙愿景方面取得了很大進展。通過與往年數(shù)據(jù)的對比,可以看出Meta擁抱AI對于自身業(yè)績的提升起到了積極影響。

Meta業(yè)績上漲很大一部分是源于廣告收入的增加,而AI為廣告業(yè)務(wù)的增長賦能。Mata2023年廣告收入為1319.48億美元,較2022年增加16%。對此,Meta首席財務(wù)官蘇珊·李(Susan Li)稱,通過AI技術(shù)在廣告平臺的應(yīng)用,Meta在持續(xù)改進廣告服務(wù)能力并得到客戶的積極反饋。

在AI為廣告賦能的推動下,F(xiàn)oA(應(yīng)用程序系列)實現(xiàn)業(yè)績的穩(wěn)定增長。與2022年相比,2023年的FoA實現(xiàn)收入1330.06億美元,同比增加16%。

Meta財報指出,這一增長幾乎完全是由廣告收入推動的。2023 年,Meta FoA的廣告展示量同比增長了28%,但每條廣告的平均價格同比下降了9%,部分抵消了這一影響。具體而言,投放的廣告數(shù)量與2022年的增長18%相比,增長了28%,原因是2023年所有地區(qū)的廣告展示次數(shù)都有所增長。與此相對,2023年每條廣告的平均價格下降了9%,相較于2022年的16%降幅更小。每條廣告平均價格的下降是由投放的廣告數(shù)量增加所致,尤其是在以較低費率獲利的地區(qū)和Reels等產(chǎn)品中。

同時,F(xiàn)oA核心用戶指標也超出市場預(yù)期。2023年12月,家庭日均活躍人數(shù)(DAP)為31.9億人,同比增長8%。截至2023年12月31日,家庭月活躍人數(shù)(MAP)為39.8億,同比增長6%。2023年12月,F(xiàn)acebook 日均活躍用戶(DAU)為21.1億,同比增長 6%。截至2023年12月31日,F(xiàn)acebook月活躍用戶(MAU)為30.7億,同比增長3%。

Meta在財報中指出,2024年將專注于六個關(guān)鍵投資領(lǐng)域,人工智能是其中之一。繼續(xù)加大對于生成式AI的投資,推動AI持續(xù)為Meta產(chǎn)品和服務(wù)的各個計劃賦能,包括支持應(yīng)用中內(nèi)容排名的系統(tǒng)、推薦相關(guān)內(nèi)容的發(fā)現(xiàn)引擎、開發(fā)新的生成式AI體驗,增強廣告商對用戶的吸引力,以及提高產(chǎn)品開發(fā)的效率。

中金公司分析師認為,Meta上調(diào)2024年資本開支20億美元至300億~370億美元,主要是基于AI相關(guān)基礎(chǔ)設(shè)施投入。

積極擁抱AI的Meta

2022年,Meta深陷元宇宙泥沼,徘徊低谷,而如今以AI領(lǐng)域的開源路線扭轉(zhuǎn)局勢。

2023年7月,Meta與微軟合作發(fā)布了開源模型LlaMa 2,包含70億、130億和700億三種參數(shù)類型,可免費用于商業(yè)或者研究。

后續(xù),Meta的開源AI殺出了OpenAI、谷歌主導(dǎo)的AI閉源模型“重圍”,重新開辟出了一條道路。LlaMa 2將由微軟通過其云服務(wù)分發(fā),并在 Windows操作系統(tǒng)上運行。LlaMa 2相比LlaMa1在性能、訓(xùn)練數(shù)據(jù)、安全等方面升級明顯,性能已經(jīng)接近GPT3.5,對當前AI發(fā)展帶來的影響不容忽視。富國銀行、IBM等如今都部署了基于LlaMa 2的開源模型。

探索AI與應(yīng)用生態(tài)結(jié)合,Meta在擁抱AI道路上越走越遠。

Meta在2月2日的財報電話會議上給出了選擇開源路線的理由,認為開源改善了Meta的模型,在戰(zhàn)略上擁有諸多優(yōu)勢,且不會消除Meta產(chǎn)品的差異化。

首先,開源軟件通常更安全、更可靠,同時由于社區(qū)的持續(xù)反饋、審查和開發(fā),運行效率更高。而效率的提高和計算成本的降低也讓包括Meta在內(nèi)的每個人都受益;其次,開源軟件通常會成為行業(yè)標準。Meta表示,當其他公司使用Meta的技術(shù)棧進行標準化構(gòu)建時,Meta就能更容易將其他公司的創(chuàng)新整合到自己的產(chǎn)品中,這種快速學(xué)習(xí)和改進的能力是一個巨大的優(yōu)勢;最后,開源在開發(fā)者和研究人員中非常受歡迎,這有助于Meta招募到最好的人才。

同時,Meta再次強調(diào)其掌握獨特的數(shù)據(jù),并且構(gòu)建了獨特的產(chǎn)品集成,所以提供像LlaMa這樣的開源基礎(chǔ)設(shè)施并不會削弱Meta的主要優(yōu)勢,Meta也會將其作為前進的正確途徑。

Meta還表示,LlaMa 3正在訓(xùn)練當中,近期也會陸續(xù)推出Meta AI、AI Studio以及搭載AI功能的Quest3及智能眼鏡等toC產(chǎn)品。

據(jù)市場消息,Meta今年還計劃部署自研定制芯片。這款芯片將產(chǎn)自Meta的第二代內(nèi)部芯片生產(chǎn)線,于2024年投產(chǎn),能有助于減少對占據(jù)AI芯片市場主導(dǎo)地位的英偉達旗下昂貴AI芯片的重度依賴。同時,在Meta計劃推出新的人工智能產(chǎn)品之際,自研芯片能夠控制與人工智能訓(xùn)練等相關(guān)的成本。

此外,Meta的應(yīng)用保持強勁的AI參與度, Facebook、Instagram、Messenger、WhatsApp等家族應(yīng)用已經(jīng)接入AI功能,在APP中推出超過20種的AI工具。今年Meta已形成了包括LlaMa 2、Threads、Reels以及Quest 3在內(nèi)的產(chǎn)品路線圖。此外,Meta也在推動元宇宙從VR向XR轉(zhuǎn)變。

中金公司分析師認為,Meta2024年AI產(chǎn)品化落地值得期待。

眼下,Yann LeCun討伐Sora蹭“世界模型”的舉動,一定程度上也是Meta與OpenAI在走向AGI的路徑差異,非生成式與生成式、開源與閉源,他們將在后續(xù)路途中走出更大的背離,但目標并沒有什么區(qū)別。

來源:21世紀經(jīng)濟報道 作者:孔海麗

京公網(wǎng)安備 11010802028547號

京公網(wǎng)安備 11010802028547號